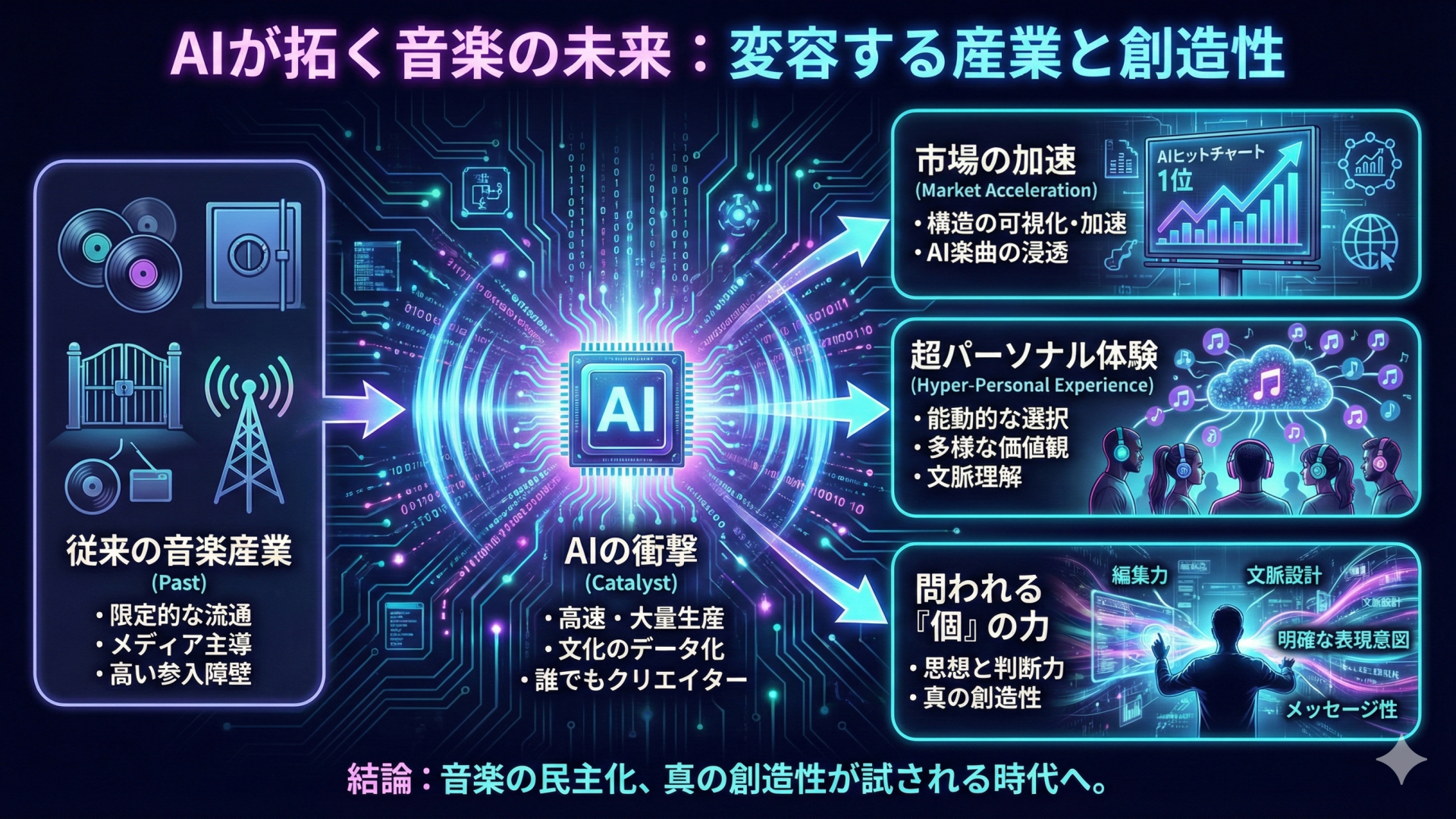

私たちが親しんできた「音楽」という概念そのものが、いま大きな転換点を迎えています。生成AIによる音楽制作は、単に新しい作曲ツールが登場したという話ではなく、これまで人類が積み重ねてきた音楽文化をデータとして再構成し、極めて高速かつ大量に再生産・消費させる仕組みを生み出しました。

すでにその影響は現実のものとなっています。たとえば、SunoやUdioといったAI音楽生成サービスでは、専門的な音楽教育を受けていない人でも、数分で完成度の高い楽曲を制作できます。また、SpotifyやYouTube上では、AI生成と明示された楽曲や、実質的にAIが主体となって作られた楽曲が再生数を伸ばす事例も現れ始めています。さらに、BGMやジングル、作業用音楽といった分野では、すでに「人が作ったかどうか」がほとんど問題にならないケースも増えています。

アメリカではリスナー(18~44歳)の50~60%がAI生成音楽を聴いているというリサーチ結果も出ていて、ビルボードでもAI制作の音楽が1位を獲得しています。

こうした変化に対して、創作の本質が損なわれるのではないかという反発が存在するのも事実です。しかし、AI音楽はその是非を議論している間にも、圧倒的な生成量と供給速度によって市場に浸透し、私たちの音楽との向き合い方そのものを静かに変えつつあります。この流れ自体を止めることは、もはや現実的ではありません。

もともと音楽市場は、「優れた音楽だけが評価される世界」ではありませんでした。流通、宣伝、アルゴリズム、タイミングといった市場経済の力学が常に作用してきました。AIの導入は、その構造を可視化し、さらに加速させたに過ぎないとも言えます。それが創作にとって良いことなのか、あるいは望ましくないのか。その判断は単純ではなく、私たちはこの両義的な影響を冷静に見極める段階に入っています。

リスナー側の環境も大きく変わりました。かつては、限られたメディアやレーベルによって編成された価値観の中で、楽曲が「届く・届かない」が決まっていました。しかし現在は、無数の楽曲が並列に存在し、どれを選び取るかは、個々人の知識、感性、文脈理解に委ねられています。AIの普及は、この傾向をさらに強め、音楽体験をよりパーソナルなものへと押し進めています。

一方で、作り手にとっての参入障壁は確実に下がりました。技術的には、すでに誰もが「ミュージシャン」になれる時代です。ただし、それが即座に優れた楽曲の量産につながっているわけではありません。メッセージ性、時代との接続、歌詞や構成の完成度といった要素は、AI以前と変わらず、むしろより厳しく問われるようになっています。

大量消費される音楽の中で埋もれずに生き残るためには、単に生成ツールを使いこなすだけでなく、編集力、文脈設計、表現意図の明確さといった総合的な能力が必要になります。創作の「楽さ」と引き換えに、作り手個人の思想や判断力が、これまで以上に露わになる時代とも言えるでしょう。

総じて見れば、AI音楽の時代は、作り手にとって非常に刺激的である一方、安易さがそのまま露呈する厳しい時代でもあります。音楽が民主化されたからこそ、個人が何を考え、何を表現しようとしているのか。その輪郭が、これまで以上に明確に問われる局面に入ったのだと思われます。

引き続き、Gemini の Deep Resarch による2030年までのストリーミング市場における変化を予想させます。

上記概要

日本の音楽市場は、ボーカロイド文化とCDの根強い人気という特異な構造により、欧米と異なりAI音楽を「新しい楽器」や「キャラクター」として受け入れる先進市場であると結論付けています。

AI音楽接触者数(月間アクティブリスナー:MAU)は、2024年の推計2,240万人(ストリーミング利用者の約35%)から、2030年には8,190万人(同90%)へと爆発的に拡大すると予測されています。

この拡大は、集中・睡眠用のBGMの完全AI化、AI歌唱技術による「ハイブリッド・アイドル」の台頭、そしてプラットフォームのアルゴリズムによる低コストなAI楽曲の受動的聴取の常態化によって牽引されます。2030年には、AIは「人間の敵」ではなく「拡張された楽器」としてJ-Popのエコシステムに完全に組み込まれる、と予測しています。